其他计算机视觉问题

上一章学习了实践中训练模型的一些基本技术,例如:学习率和周期律的选择。这一章我们需要深入学习其他两种机器视觉问题。

多标签分类:发生在你想要预测每个图像的多个标签(有时甚至没有标签)

回归: 你的标签是一个或多个数字——数量而不是类别。

这需要深入学习:输出激活,目标和损失函数。

多标签分类

多标签分类指的是识别图像中可能不只包含一种对象类别的问题。可能有多种对象,或者在你寻找的类别中根本没有对象。

tip:模型架构与前一章没有大改变,只有损失函数改变了。

数据

对于我们的示例,我们将使用 PASCAL 数据集,该数据集中的每个图像可以有多种分类对象。

我们首先按照通常的方式下载和提取数据集:

1 | from fastai.vision.all import * |

这个数据集与我们之前看到的不同,它不是按文件名或文件夹结构化的,而是附带一个 CSV 文件,告诉我们每个图像要使用的标签。我们可以通过将其读入 Pandas DataFrame 来检查 CSV 文件:

1 | df = pd.read_csv(path/'train.csv') |

| 文件名 | 标签 | 是否有效 | |

|---|---|---|---|

| 0 | 000005.jpg | 椅子 | True |

| 1 | 000007.jpg | 汽车 | True |

| 2 | 000009.jpg | 马 人 | True |

| 3 | 000012.jpg | 汽车 | False |

| 4 | 000016.jpg | 自行车 | True |

正如你所看到的,每个图像中的类别列表显示为一个以空格分隔的字符串。

既然我们已经看到了数据的样子,让我们准备好进行模型训练。

构建数据块

将DataFrame对象转换为DataLoaders对象:使用数据块API 来创建DataLoaders对象,因为它提供了灵活性和简单性的良好组合。

以该数据集为例,展示使用数据块 API 构建DataLoaders对象的实践步骤。

数据集

返回单个项目的独立变量和依赖变量的元组的集合

数据加载器

提供一系列小批量的迭代器,其中每个小批量是一批独立变量和一批因变量的组合

除此之外,fastai 还提供了两个类来将您的训练和验证集合在一起:

Datasets

包含一个训练Dataset和一个验证Dataset的迭代器

DataLoaders

包含一个训练DataLoader和一个验证DataLoader的对象

由于DataLoader是建立在Dataset之上并为其添加附加功能(将多个项目整合成一个小批量),通常最容易的方法是首先创建和测试Datasets,然后再查看DataLoaders。

当我们创建DataBlock时,我们逐步逐步构建,并使用笔记本检查我们的数据。这是一个很好的方式,可以确保您在编码时保持动力,并留意任何问题。易于调试,因为您知道如果出现问题,它就在您刚刚输入的代码行中!

让我们从没有参数创建的数据块开始,这是最简单的情况:1

dblock = DataBlock()

我们可以从中创建一个Datasets对象。唯一需要的是一个源——在这种情况下是我们的 DataFrame:

1 | dsets = dblock.datasets(df) |

这包含一个train和一个valid数据集,我们可以对其进行索引:

1 | dsets.train[0] |

1 | (fname 008663.jpg |

正如您所看到的,这只是简单地两次返回 DataFrame 的一行。这是因为默认情况下,数据块假定我们有两个东西:输入和目标。我们需要从 DataFrame 中获取适当的字段,可以通过传递get_x和get_y函数来实现:

1 | dblock = DataBlock(get_x = lambda r: r['fname'], get_y = lambda r: r['labels']) |

1 | ('005620.jpg', 'aeroplane') |

正如您所看到的,我们并没有以通常的方式定义函数,而是使用了 Python 的lambda关键字。这只是定义并引用函数的一种快捷方式。以下更冗长的方法是相同的:

1 | def get_x(r): return r['fname'] |

1 | ('002549.jpg', 'tvmonitor') |

tip:Lambda 函数非常适合快速迭代,但不兼容序列化,因此我们建议您在训练后要导出您的Learner时使用更冗长的方法(如果您只是在尝试实验,lambda 是可以的)。

我们可以看到独立变量需要转换为完整路径,以便我们可以将其作为图像打开,而因变量需要根据空格字符(这是 Python 的split函数的默认值)进行拆分,以便它变成一个列表:

1 | def get_x(r): return path/'train'/r['fname'] |

1 | (Path('/home/sgugger/.fastai/data/pascal_2007/train/008663.jpg'), |

要实际打开图像并将其转换为张量,我们需要使用一组转换;块类型将为我们提供这些。我们可以使用先前使用过的相同块类型,只有一个例外:ImageBlock将再次正常工作,因为我们有一个指向有效图像的路径,但CategoryBlock不会起作用。问题在于该块返回一个单个整数,但我们需要为每个项目有多个标签。为了解决这个问题,我们使用MultiCategoryBlock。这种类型的块期望接收一个字符串列表,就像我们在这种情况下所做的那样,所以让我们来测试一下:

1 | dblock = DataBlock(blocks=(ImageBlock, MultiCategoryBlock), |

1 | (PILImage mode=RGB size=500x375, |

正如您所看到的,我们的类别列表的编码方式与常规的CategoryBlock不同。在那种情况下,我们有一个整数表示哪个类别存在,基于它在我们的词汇表中的位置。然而,在这种情况下,我们有一系列 0,其中任何位置上有一个 1 表示该类别存在。例如,如果第二和第四位置上有一个 1,那意味着词汇项二和四在这个图像中存在。这被称为独热编码。我们不能简单地使用类别索引列表的原因是每个列表的长度都不同,而 PyTorch 需要张量,其中所有内容必须是相同长度。

专业术语: 独热编码

使用一个 0 向量,其中每个位置都表示数据中表示的位置,以编码一个整数列表。

使用torch.where函数表明这个例子中的类代表什么。1

2idxs = torch.where(dsets.train[0][1]==1.)[0]

dsets.train.vocab[idxs]

1 | (#1) ['dog'] |

使用 NumPy 数组、PyTorch 张量和 fastai 的L类,我们可以直接使用列表或向量进行索引,这使得很多代码(比如这个例子)更清晰、更简洁。

到目前为止,我们忽略了列is_valid,这意味着DataBlock一直在使用默认的随机拆分。要明确选择我们验证集的元素,我们需要编写一个函数并将其传递给splitter(或使用 fastai 的预定义函数或类之一)。它将获取项目(这里是我们整个 DataFrame)并必须返回两个(或更多)整数列表:

1 | def splitter(df): |

1 | (PILImage mode=RGB size=500x333, |

正如我们讨论过的,DataLoader将Dataset中的项目整理成一个小批量。这是一个张量的元组,其中每个张量简单地堆叠了Dataset项目中该位置的项目。

现在我们已经确认了单个项目看起来没问题,还有一步,我们需要确保我们可以创建我们的DataLoaders,即确保每个项目的大小相同。为了做到这一点,我们可以使用RandomResizedCrop:

1 | dblock = DataBlock(blocks=(ImageBlock, MultiCategoryBlock), |

现在我们可以显示我们数据的一个样本:

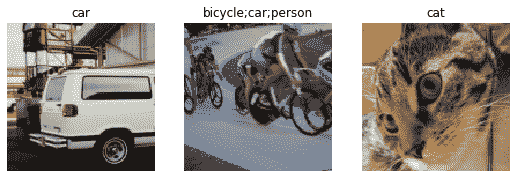

1 | dls.show_batch(nrows=1, ncols=3) |

请记住,如果在从DataBlock创建DataLoaders时出现任何问题,或者如果您想查看DataBlock的确切情况,您可以使用我们在上一章中介绍的summary方法。

我们的数据现在已经准备好用于训练模型。正如我们将看到的,当我们创建我们的Learner时,没有任何变化,但在幕后,fastai 库将为我们选择一个新的损失函数:二元交叉熵。

二元交叉熵

创建Learner时其分为四部分:模型,DataLoaders对象,优化器和要使用的损失函数。

本次我们已经构建好了DataLoaders,利用fastai的resnet模型,创建一个SGD优化器,在这章中我们专注于创建一个适合的损失函数。

1 | learn = cnn_learner(dls, resnet18) |

Learner中的模型通常是从nn.Module继承的类的对象,并且我们可以使用括号调用它,它将返回模型的激活。你应该将独立变量作为一个小批量传递给它。我们可以尝试从我们的DataLoader中获取一个小批量,然后将其传递给模型:

1 | x,y = dls.train.one_batch() |

1 | torch.Size([64, 20]) |

批量大小为 64,我们需要计算 20 个类别中的每一个的概率。其中一个激活的样子如下:

1 | activs[0] |

1 | tensor([ 2.0258, -1.3543, 1.4640, 1.7754, -1.2820, -5.8053, 3.6130, 0.7193, |

获取模型激活

手动获取一个小批量并将其传递到模型中,并查看激活和损失,对于调试模型非常重要。这对学习也非常有帮助,这样你就可以清楚地看到发生了什么。

它们还没有缩放到 0 到 1 之间,但我们学会了如何在第四章中使用sigmoid函数来做到这一点。我们还看到了如何基于此计算损失——这是我们在第四章中的损失函数,加上了在前一章中讨论的log:

1 | def binary_cross_entropy(inputs, targets): |

请注意,由于我们有一个独热编码的因变量,我们不能直接使用nll_loss或softmax(因此我们不能使用cross_entropy):

正如我们所看到的,

softmax要求所有预测总和为 1,并且倾向于使一个激活远远大于其他激活(因为使用了exp);然而,我们可能有多个我们确信出现在图像中的对象,因此限制激活的最大总和为 1 并不是一个好主意。出于同样的原因,如果我们认为任何类别都不出现在图像中,我们可能希望总和小于1。正如我们所看到的,

nll_loss返回的是一个激活值:与项目的单个标签对应的单个激活值。当我们有多个标签时,这是没有意义的。

另一方面,binary_cross_entropy函数,即mnist_loss加上log,正是我们所需要的,这要归功于 PyTorch 的逐元素操作的魔力。每个激活将与每个列的每个目标进行比较,因此我们不必做任何事情使此函数适用于多个列。

Jeremy Says

我真的很喜欢使用像 PyTorch 这样的库,具有广播和逐元素操作,因为我经常发现我可以编写的代码同样适用于单个项目或一批项目,而无需更改。binary_cross_entropy就是一个很好的例子。通过使用这些操作,我们不必自己编写循环,可以依赖 PyTorch 根据我们正在处理的张量的秩适当地执行我们需要的循环。

PyTorch 已经为我们提供了这个函数。实际上,它提供了许多版本,名称相当令人困惑!

F.binary_cross_entropy及其模块等效nn.BCELoss计算一个独热编码目标的交叉熵,但不包括初始的sigmoid。通常,对于独热编码目标,您将希望使用F.binary_cross_entropy_with_logits(或nn.BCEWithLogitsLoss),它们在一个函数中同时执行 sigmoid 和二元交叉熵,就像前面的例子一样。

对于单标签数据集(如 MNIST 或 Pet 数据集),其中目标被编码为单个整数,相应的是F.nll_loss或nn.NLLLoss(没有初始 softmax 的版本),以及F.cross_entropy或nn.CrossEntropyLoss(具有初始 softmax 的版本)。

由于我们有一个独热编码的目标,我们将使用BCEWithLogitsLoss:

1 | loss_func = nn.BCEWithLogitsLoss() |

1 | tensor(1.0082, device='cuda:5', grad_fn=<BinaryCrossEntropyWithLogitsBackward>) |

我们不需要告诉 fastai 使用这个损失函数(尽管如果我们想要的话可以这样做),因为它将自动为我们选择。fastai 知道DataLoaders具有多个类别标签,因此默认情况下将使用nn.BCEWithLogitsLoss。

与前一章相比的一个变化是我们使用的指标:因为这是一个多标签问题,我们不能使用准确度函数。为什么呢?嗯,准确度是这样比较我们的输出和我们的目标的:

1 | def accuracy(inp, targ, axis=-1): |

预测的类是具有最高激活的类(这就是argmax的作用)。这里不起作用,因为我们可能在单个图像上有多个预测。在对我们的激活应用 sigmoid(使它们在 0 和 1 之间)之后,我们需要通过选择阈值来决定哪些是 0,哪些是 1。高于阈值的每个值将被视为 1,低于阈值的每个值将被视为 0:

1 | def accuracy_multi(inp, targ, thresh=0.5, sigmoid=True): |

如果我们直接将accuracy_multi作为指标传递,它将使用threshold的默认值,即 0.5。我们可能希望调整该默认值并创建一个具有不同默认值的新版本的accuracy_multi。为了帮助解决这个问题,Python 中有一个名为partial的函数。它允许我们绑定一个带有一些参数或关键字参数的函数,从而创建该函数的新版本,每当调用它时,总是包含这些参数。例如,这里是一个接受两个参数的简单函数:

1 | def say_hello(name, say_what="Hello"): return f"{say_what} {name}." |

1 | ('Hello Jeremy.', 'Ahoy! Jeremy.') |

我们可以通过使用partial切换到该函数的法语版本:

1 | f = partial(say_hello, say_what="Bonjour") |

1 | ('Bonjour Jeremy.', 'Bonjour Sylvain.') |

现在我们可以训练我们的模型。让我们尝试将准确度阈值设置为 0.2 作为我们的指标:

1 | learn = cnn_learner(dls, resnet50, metrics=partial(accuracy_multi, thresh=0.2)) |

| epoch | train_loss | valid_loss | accuracy_multi | time |

|---|---|---|---|---|

| 0 | 0.903610 | 0.659728 | 0.263068 | 00:07 |

| 1 | 0.724266 | 0.346332 | 0.525458 | 00:07 |

| 2 | 0.415597 | 0.125662 | 0.937590 | 00:07 |

| 3 | 0.254987 | 0.116880 | 0.945418 | 00:07 |

| epoch | train_loss | valid_loss | accuracy_multi | time |

| —- | —- | —- | —- | —- |

| 0 | 0.123872 | 0.132634 | 0.940179 | 00:08 |

| 1 | 0.112387 | 0.113758 | 0.949343 | 00:08 |

| 2 | 0.092151 | 0.104368 | 0.951195 | 00:08 |

选择阈值很重要。如果选择的阈值太低,通常会选择错误标记的对象。我们可以通过改变我们的度量标准然后调用validate来看到这一点,它会返回验证损失和度量标准:

1 | learn.metrics = partial(accuracy_multi, thresh=0.1) |

1 | (#2) [0.10436797887086868,0.93057781457901] |

如果选择的阈值太高,将只选择模型非常有信心的对象:

1 | learn.metrics = partial(accuracy_multi, thresh=0.99) |

1 | (#2) [0.10436797887086868,0.9416930675506592] |

我们可以通过尝试几个级别并查看哪个效果最好来找到最佳阈值。如果我们只抓取一次预测,这将快得多:

1 | preds,targs = learn.get_preds() |

然后我们可以直接调用度量标准。请注意,默认情况下,get_preds会为我们应用输出激活函数(在本例中为 sigmoid),因此我们需要告诉accuracy_multi不要应用它:

1 | accuracy_multi(preds, targs, thresh=0.9, sigmoid=False) |

1 | TensorMultiCategory(0.9554) |

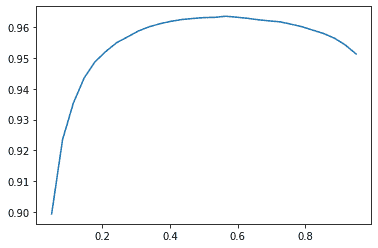

现在我们可以使用这种方法找到最佳阈值水平:

1 | xs = torch.linspace(0.05,0.95,29) |

在这种情况下,我们使用验证集来选择一个超参数(阈值),这就是验证集的目的。有时学生们表达了他们的担忧,即我们可能会对验证集过拟合,因为我们正在尝试很多值来找出哪个是最好的。然而,正如你在图中看到的,改变阈值在这种情况下会产生一个平滑的曲线,因此我们显然没有选择不合适的异常值。这是一个很好的例子,说明你必须小心理论(不要尝试很多超参数值,否则可能会过拟合验证集)与实践(如果关系是平滑的,这样做是可以的)之间的区别。

回归

很容易将深度学习模型视为被分类到领域中,如计算机视觉、NLP等等。事实上,这就是 fastai 对其应用程序进行分类的方式——主要是因为大多数人习惯于这样思考事物。

但实际上,这隐藏了一个更有趣和更深入的视角。一个模型由其独立和依赖变量以及其损失函数定义。这意味着实际上有比简单的基于领域的分割更广泛的模型数组。也许我们有一个独立变量是图像,一个依赖变量是文本(例如,从图像生成标题);或者我们有一个独立变量是文本,一个依赖变量是图像(例如,从标题生成图像——这实际上是深度学习可以做到的!);或者我们有图像、文本和表格数据作为独立变量,我们试图预测产品购买……可能性真的是无穷无尽的。

要能够超越固定应用程序,为新问题制定自己的新颖解决方案,真正理解数据块 API(也许还有我们将在本书后面看到的中间层 API)是有帮助的。举个例子,让我们考虑图像回归的问题。这指的是从一个独立变量是图像,依赖变量是一个或多个浮点数的数据集中学习。通常我们看到人们将图像回归视为一个完全独立的应用程序——但正如你在这里看到的,我们可以将其视为数据块 API 上的另一个 CNN。

我们将直接跳到图像回归的一个有点棘手的变体,因为我们知道你已经准备好了!我们将做一个关键点模型。关键点指的是图像中表示的特定位置——在这种情况下,我们将使用人物的图像,并且我们将寻找每个图像中人脸的中心。这意味着我们实际上将为每个图像预测两个值:人脸中心的行和列。

数据组装

我们将在这一部分使用Biwi Kinect Head Pose 数据集。我们将像往常一样开始下载数据集:

1 | path = untar_data(URLs.BIWI_HEAD_POSE) |

让我们看看我们有什么!

1 | path.ls() |

1 | (#50) [Path('13.obj'),Path('07.obj'),Path('06.obj'),Path('13'),Path('10'),Path(' |

有 24 个从 01 到 24 编号的目录(它们对应不同的被摄人物),以及每个目录对应的.obj文件(我们这里不需要)。让我们看看其中一个目录的内容:1

(path/'01').ls()

1 | (#1000) [Path('01/frame_00281_pose.txt'),Path('01/frame_00078_pose.txt'),Path('0 |

在子目录中,我们有不同的帧。每个帧都带有一个图像(_rgb.jpg)和一个姿势文件(_pose.txt)。我们可以使用get_image_files轻松递归获取所有图像文件,然后编写一个函数,将图像文件名转换为其关联的姿势文件:

1 | img_files = get_image_files(path) |

1 | Path('13/frame_00349_pose.txt') |

让我们来看看我们的第一张图片:

1 | im = PILImage.create(img_files[0]) |

1 | (480, 640) |

1 | im.to_thumb(160) |

Biwi 数据集网站用于解释与每个图像关联的姿势文本文件的格式,显示头部中心的位置。这些细节对我们来说并不重要,所以我们只会展示我们用来提取头部中心点的函数:

1 | cal = np.genfromtxt(path/'01'/'rgb.cal', skip_footer=6) |

这个函数将坐标作为两个项目的张量返回:

1 | get_ctr(img_files[0]) |

1 | tensor([384.6370, 259.4787]) |

我们可以将此函数传递给DataBlock作为get_y,因为它负责为每个项目标记。我们将将图像调整为其输入大小的一半,以加快训练速度。

一个重要的要点是我们不应该只使用随机分割器。在这个数据集中,同一个人出现在多个图像中,但我们希望确保我们的模型可以泛化到它尚未见过的人。数据集中的每个文件夹包含一个人的图像。因此,我们可以创建一个分割器函数,仅为一个人返回True,从而使验证集仅包含该人的图像。

与以前的数据块示例的唯一区别是第二个块是PointBlock。这是必要的,以便 fastai 知道标签代表坐标;这样,它就知道在进行数据增强时,应该对这些坐标执行与图像相同的增强:

1 | biwi = DataBlock( |

点和数据增强

我们不知道其他库(除了 fastai)会自动且正确地将数据增强应用于坐标。因此,如果您使用另一个库,可能需要禁用这些问题的数据增强。

在进行任何建模之前,我们应该查看我们的数据以确认它看起来没问题:

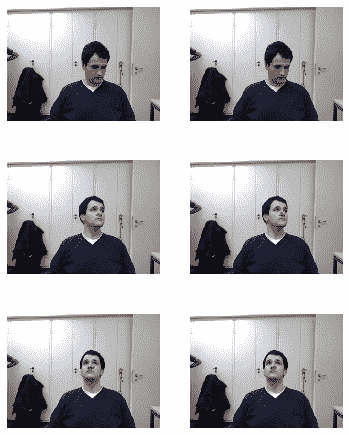

1 | dls = biwi.dataloaders(path) |

看起来不错!除了通过视觉查看批次外,还可以查看底层张量(尤其是作为学生;这将有助于澄清您对模型实际看到的内容的理解):

1 | xb,yb = dls.one_batch() |

1 | (torch.Size([64, 3, 240, 320]), torch.Size([64, 1, 2])) |

确保您了解为什么这些是我们小批量的形状。

这是依赖变量的一个示例行:

1 | yb[0] |

1 | tensor([[0.0111, 0.1810]], device='cuda:5') |

正如您所看到的,我们不必使用单独的图像回归应用程序;我们所要做的就是标记数据并告诉 fastai 独立变量和因变量代表什么类型的数据。

创建我们的Learner也是一样的。我们将使用与之前相同的函数,只有一个新参数,然后我们就可以准备训练我们的模型了。

训练模型

像往常一样,我们可以使用cnn_learner来创建我们的Learner。还记得在第一章中我们如何使用y_range告诉 fastai 我们目标的范围吗?我们将在这里做同样的事情(fastai 和 PyTorch 中的坐标始终在-1 和+1 之间重新缩放):

1 | learn = cnn_learner(dls, resnet18, y_range=(-1,1)) |

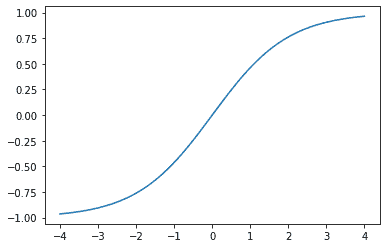

y_range在 fastai 中使用sigmoid_range实现,其定义如下:

1 | def sigmoid_range(x, lo, hi): return torch.sigmoid(x) * (hi-lo) + lo |

如果定义了y_range,则将其设置为模型的最终层。花点时间思考一下这个函数的作用,以及为什么它强制模型在范围(lo,hi)内输出激活。

这是它的样子:

1 | plot_function(partial(sigmoid_range,lo=-1,hi=1), min=-4, max=4) |

我们没有指定损失函数,这意味着我们得到了 fastai 选择的默认值。让我们看看它为我们选择了什么:

1 | dls.loss_func |

1 | FlattenedLoss of MSELoss() |

这是有道理的,因为当坐标被用作因变量时,大多数情况下我们可能会尽可能地预测接近某个值;这基本上就是 MSELoss(均方误差损失)所做的。如果你想使用不同的损失函数,你可以通过使用 loss_func 参数将其传递给 cnn_learner。

还要注意,我们没有指定任何指标。这是因为均方误差已经是这个任务的一个有用指标(尽管在我们取平方根之后可能更易解释)。

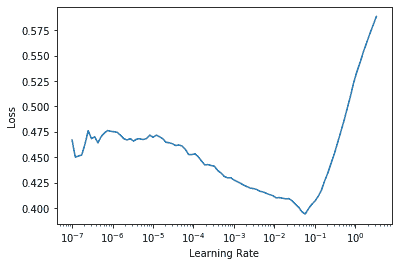

我们可以使用学习率查找器选择一个好的学习率:

1 | learn.lr_find() |

我们将尝试一个学习率为 2e-2:

1 | lr = 2e-2 |

| epoch | train_loss | valid_loss | time |

|---|---|---|---|

| 0 | 0.045840 | 0.012957 | 00:36 |

| 1 | 0.006369 | 0.001853 | 00:36 |

| 2 | 0.003000 | 0.000496 | 00:37 |

| 3 | 0.001963 | 0.000360 | 00:37 |

| 4 | 0.001584 | 0.000116 | 00:36 |

通常情况下,当我们运行这个时,我们得到的损失大约是 0.0001,这对应于这个平均坐标预测误差:

1 | math.sqrt(0.0001) |

1 | 0.01 |

这听起来非常准确!但是重要的是要用 Learner.show_results 查看我们的结果。左侧是实际(真实)坐标,右侧是我们模型的预测:

1 | learn.show_results(ds_idx=1, max_n=3, figsize=(6,8)) |

令人惊讶的是,仅仅几分钟的计算,我们就创建了一个如此准确的关键点模型,而且没有任何特定领域的应用。这就是在灵活的 API 上构建并使用迁移学习的力量!特别引人注目的是,我们能够如此有效地使用迁移学习,即使在完全不同的任务之间;我们的预训练模型是用来进行图像分类的,而我们对图像回归进行了微调。

结论

在乍一看完全不同的问题(单标签分类、多标签分类和回归)中,我们最终使用相同的模型,只是输出的数量不同。唯一改变的是损失函数,这就是为什么重要的是要仔细检查你是否为你的问题使用了正确的损失函数。

fastai 将自动尝试从您构建的数据中选择正确的损失函数,但如果您使用纯 PyTorch 构建您的 DataLoader,请确保您认真考虑您选择的损失函数,并记住您很可能想要以下内容:

nn.CrossEntropyLoss用于单标签分类nn.BCEWithLogitsLoss用于多标签分类nn.MSELoss用于回归

课后题

- 多标签分类如何提高熊分类器的可用性?

- 当图片名中没有熊或是出现的不是熊时他能够进行辨别

- 在多标签分类问题中,我们如何对因变量进行编码?

- 因变量需要根据空格字符(这是 Python 的

split函数的默认值)进行拆分,以便它变成一个列表

- 如何访问 DataFrame 的行和列,就像它是一个矩阵一样?

- 访问 DataFrame 行和列:使用 iloc 按整数位置或 loc 按标签索引(如 df.iloc[行,列] 或 df.loc[行标签,列标签])。

- 如何从 DataFrame 中按名称获取列?

- 按名称获取列:通过 df[“列名”] 获取单列(Series),或 df[[“列名”]] 保持 DataFrame 结构,列名特殊时用方括号。

Dataset和DataLoader之间有什么区别?

- 由于

DataLoader是建立在Dataset之上并为其添加附加功能(将多个项目整合成一个小批量),通常最容易的方法是首先创建和测试Datasets,然后再查看DataLoaders。

Datasets对象通常包含什么?

- 包含一个训练

Dataset和一个验证Dataset的迭代器

DataLoaders对象通常包含什么?

- 包含一个训练

DataLoader和一个验证DataLoader的对象

lambda在 Python 中是做什么的?

- 这只是定义并引用函数的一种快捷方式

- 如何使用数据块 API 自定义独立变量和因变量的创建方法?

- 使用数据块 API 时,通过 get_x 和 get_y 参数分别定义处理输入(独立变量)和输出(因变量)的自定义方法,例如:

DataBlock(get_x=自定义函数, get_y=自定义函数)。

- 当使用一个独热编码的目标时,为什么 softmax 不是一个合适的输出激活函数?

- 因为所有类别概率总和并不为1

- 当使用一个独热编码的目标时,为什么

nll_loss不是一个合适的损失函数?

nll_loss返回的是一个激活值:与项目的单个标签对应的单个激活值。当我们有多个标签时,这是没有意义的。

nn.BCELoss和nn.BCEWithLogitsLoss之间有什么区别?

nn.BCELoss计算一个独热编码目标的交叉熵,但不包括初始的sigmoid。nn.BCEWithLogitsLoss它在一个函数中同时执行 sigmoid 和二元交叉熵,就像前面的例子一样。

- 为什么在多标签问题中不能使用常规准确率?

- 在多标签问题中,常规准确率要求 所有标签完全正确匹配,而实际场景中部分标签预测正确即可有效,导致常规准确率过于严格且无法反映模型部分预测的有效性。

- 何时可以在验证集上调整超参数?

- 在验证集上调整超参数是标准做法,但需确保 测试集完全独立且仅用于最终评估,避免调整过程中信息泄漏导致过拟合和评估偏差。

y_range在 fastai 中是如何实现的?(看看你是否可以自己实现并在不偷看的情况下测试!)

- 在 fastai 中,y_range 通过 在模型输出层添加 Sigmoid 激活函数并线性缩放到指定范围 实现,适用于回归任务以约束预测值的合理区间(如 (a, b))。

- 回归问题是什么?对于这样的问题应该使用什么损失函数?

- 回归问题是预测连续数值的任务(如价格、温度),常用 均方误差(MSE) 或 平均绝对误差(MAE) 作为损失函数,其中 MSE 是最基础且广泛使用的选择。

- 为了确保 fastai 库将相同的数据增强应用于您的输入图像和目标点坐标,您需要做什么?

- 使用PointBlock并将空间变换(如翻转、旋转)添加到item_tfms,同时确保目标点坐标已归一化,即可使fastai对图像和坐标同步应用相同数据增强。

进一步研究

阅读关于 Pandas DataFrames 的教程,并尝试一些看起来有趣的方法。查看书籍网站上推荐的教程。

使用多标签分类重新训练熊分类器。看看你是否可以使其有效地处理不包含任何熊的图像,包括在 Web 应用程序中显示该信息。尝试一张包含两种熊的图像。检查在单标签数据集上使用多标签分类是否会影响准确性。